Worum es geht:

Nicht alle Risiken durch Bias sind gleich. Einige Stakeholder-Gruppen haben eine höhere Wahrscheinlichkeit für Bias, weil sie in deinen Daten unterrepräsentiert sind oder in Randfälle fallen. Andere sind schwerwiegenderen Folgen ausgesetzt, wenn ein Bias auftritt, möglicherweise weil die Einsätze hoch sind, der Schaden schwer rückgängig zu machen ist oder sie bereits verwundbar sind.

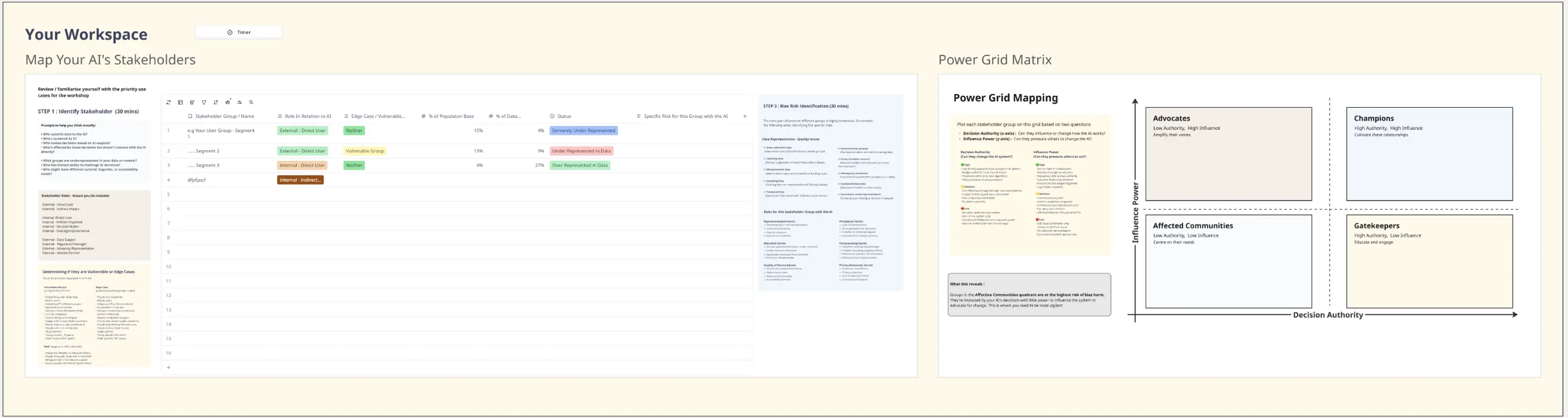

Dieses Board hilft dir, beide Dimensionen für jede Stakeholder-Gruppe zu bewerten, damit du weißt, wo du deine Minderungsbemühungen fokussieren solltest.

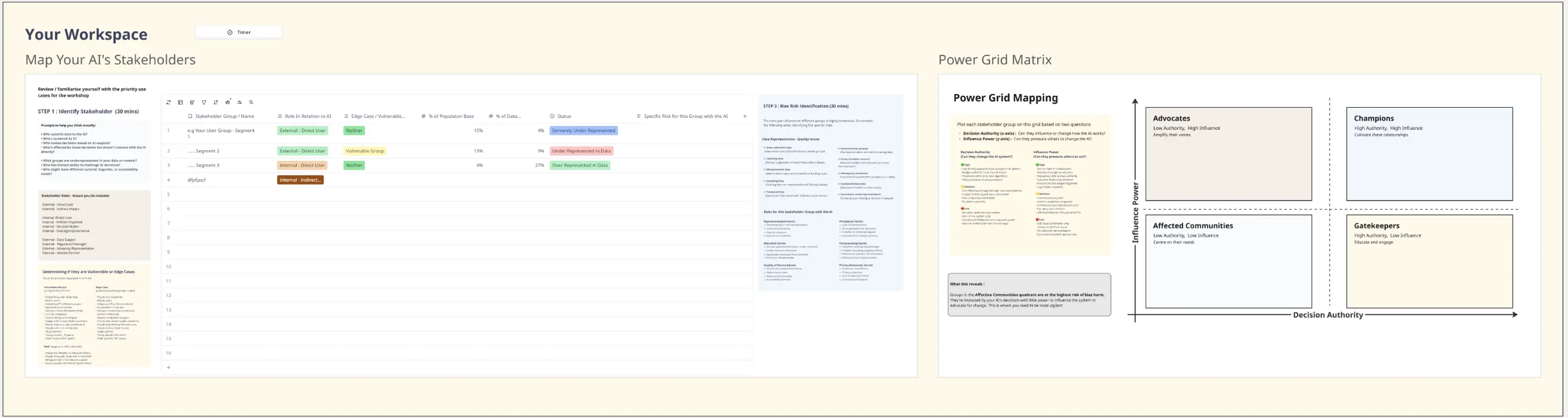

Du bewertest jede Gruppe anhand von:

Wahrscheinlichkeit von Bias: Wie gut sind sie in deinen Trainingsdaten vertreten? Fallen sie in Randgruppenmuster? Gibt es historisch bedingte Verzerrungen in deinen Datenquellen?

Schwere des Schadens: Was steht für sie auf dem Spiel? Können sie sich erholen, wenn etwas schiefläuft? Sind sie bereits in einer verletzlichen Position?

Was es dir ermöglicht zu erreichen:

Eine Risikolandkarte, die jede Stakeholder-Gruppe über vier Zonen verteilt: Kritisch, Hoch, Mittel und Niedrig.

Du erhältst eine klare, priorisierte Liste, die genau zeigt, welche Gruppen zuerst eine Intervention benötigen, anstatt zu versuchen, alles auf einmal zu beheben.

Wer am meisten profitiert:

Produktmanager, Datenwissenschaftler, Compliance-Teams und alle, die dafür verantwortlich sind, dass KI-Systeme keinen unverhältnismäßigen Schaden verursachen. Unverzichtbar für Teams, die in regulierten oder risikoreichen Bereichen tätig sind.

Wie man es verwendet:

Nehmen Sie sich 60 Minuten Zeit. Arbeiten Sie jede Stakeholder-Gruppe von Board 2 aus, bewerten Sie deren Wahrscheinlichkeits- und Schadensschwere-Scores und tragen Sie sie auf der Heat Map ein.

Dieses Board ist projektspezifisch, daher werden Sie es für jede neue KI-Initiative wiederholen, aber das Framework bleibt gleich.

Teil der AI Bias Mitigation Workshop-Reihe (Boards 3 bis 4).