소개:

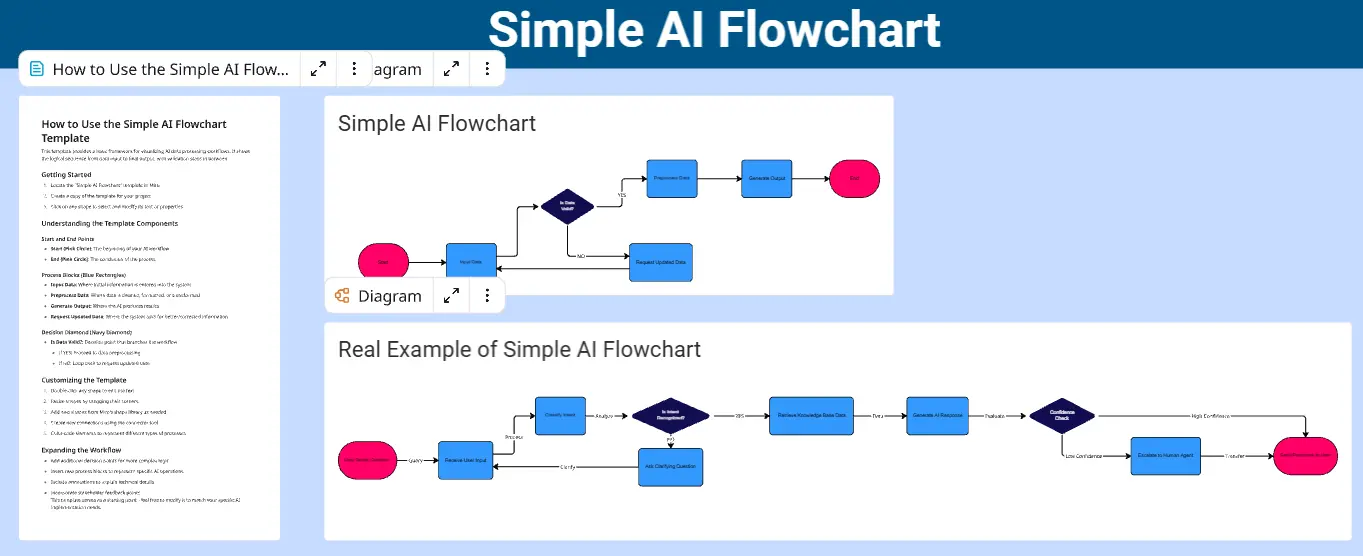

편견 위험을 평가하기 전에 AI가 실제로 누구에게 영향을 미치는지를 알아야 합니다. 이는 대개 명확한 사용자뿐만 아니라 다양한 이해관계자들에게까지 영향을 미칩니다. 이해관계자는 일반적으로 다음 네 그룹으로 나뉩니다:

직접 사용자: AI 시스템을 적극적으로 사용하는 사람들

간접 사용자: 시스템과 직접적으로 상호작용하지 않고 AI 결정에 의해 영향을 받는 사람들

내부 팀: 제품 관리자, 주요 결정권자, QA 테스터, 감사인, 법률 및 규정 준수

외부 단체: 규제 기관, 옹호 단체, 커뮤니티 조직, 미디어

이 그룹들 중 일부는 취약한 계층입니다. 어떤 그룹은 훈련 데이터에 거의 반영되지 않는 경계 사례들입니다. 이 보드는 이들을 체계적으로 매핑하여 아무도 간과되지 않게 돕습니다.

당신이 달성할 수 있는 것:

AI와 상호작용하거나 영향을 받는 각 그룹을 식별하는 포괄적인 이해관계자 맵.

취약 계층을 식별하고, 훈련 데이터의 대표성에 대한 격차를 발견하며, 이해관계자를 사용자, 의사 결정자, 영향받는 사람들, 그리고 감독 역할로 분류합니다.

이 맵은 편향 위험이 가장 높은 곳을 평가하는 기초가 됩니다.

가장 많이 혜택을 받는 사람들:

제품 관리자, 데이터 과학자, UX 리서처, AI 시스템을 구축하는 크로스 펑셔널 팀. 특히 사람들의 기회, 재정 또는 복지에 영향을 미치는 분야에서 일하는 팀에게 매우 유익합니다.

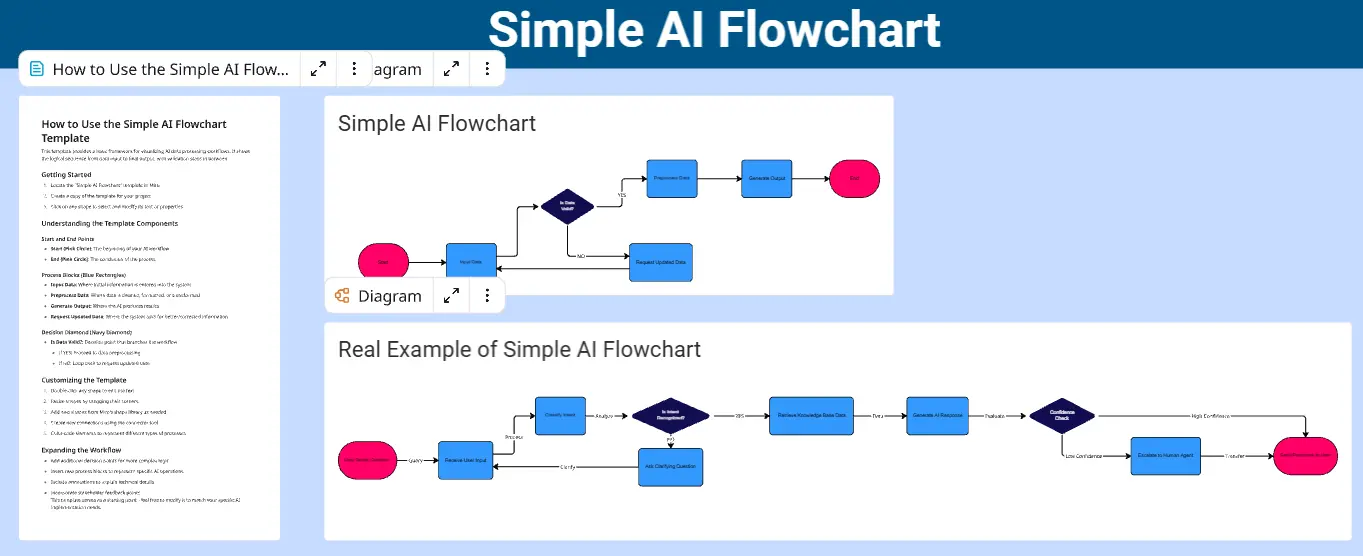

사용 방법:

첫 세션에는 60분을 할애하세요.

모든 네 가지 범주에 걸쳐 이해관계자 그룹을 브레인스토밍하세요.

누가 취약한지를 식별하고

소외된 그룹을 식별하여 이해관계자 지형에서 이들의 규모를 비교하고 각 그룹이 훈련 데이터에 얼마나 잘 나타나는지 비교하고 문서화하세요.

좋은 소식: 보드 1처럼, 이 보드도 재사용 가능합니다. 향후 프로젝트에서는 새로운 그룹을 검토하고 추가하는 데 20분만 필요합니다.

AI 편향 완화 워크숍 시리즈의 일부 (보드 1에서 4까지).