De quoi s'agit-il :

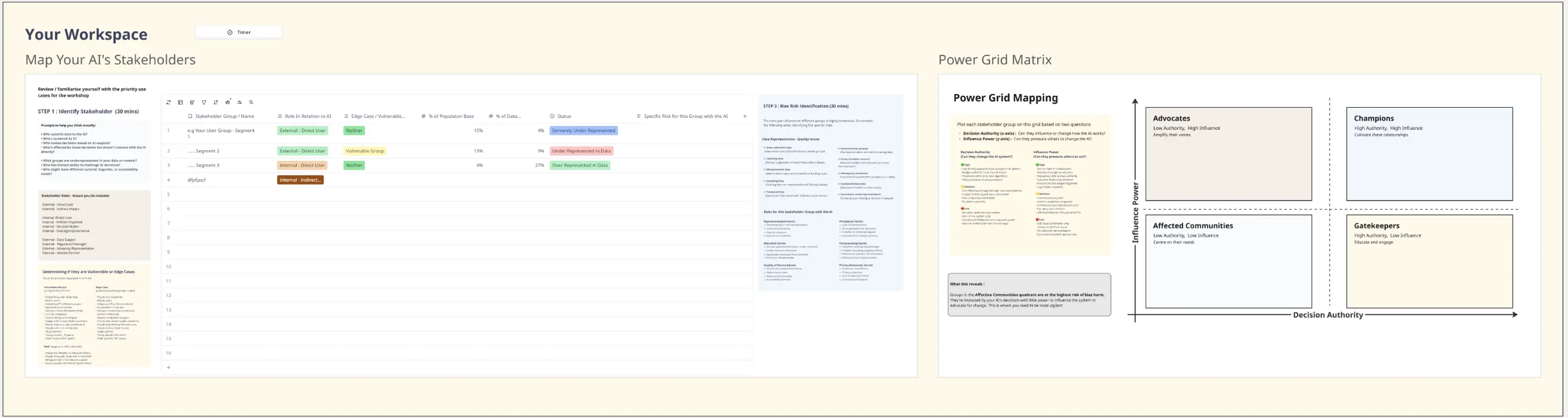

Tous les risques de biais ne sont pas égaux. Certains groupes de parties prenantes font face à une plus grande probabilité de biais parce qu'elles sont sous-représentées dans vos données ou relèvent de cas limites. D'autres font face à des conséquences plus graves si un biais survient, peut-être parce que les enjeux sont élevés, le préjudice est difficile à inverser, ou qu'elles sont déjà vulnérables.

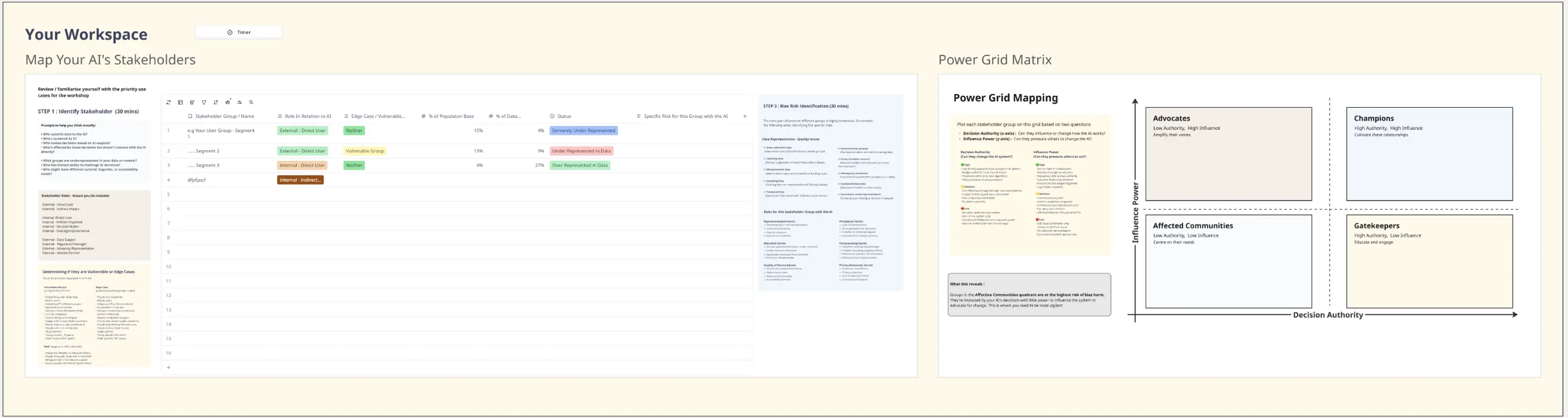

Ce tableau vous aide à évaluer les deux dimensions pour chaque groupe de parties prenantes, afin de savoir où concentrer vos efforts d'atténuation.

Vous évaluerez chaque groupe selon :

Probabilité de biais : Sont-ils bien représentés dans vos données d'entraînement ? Appartiennent-ils à des schémas de cas limites ? Y a-t-il un biais historique intégré dans vos sources de données ?

Gravité des dommages : Qu'est-ce qui est en jeu pour eux ? Peuvent-ils se rétablir si quelque chose tourne mal ? Sont-ils déjà dans une position vulnérable ?

Ce qu'il vous aide à accomplir :

Une carte des risques qui place chaque groupe de parties prenantes à travers quatre zones : Critique, Élevée, Moyenne, et Faible.

Vous repartirez avec une liste priorisée claire, indiquant exactement quels groupes nécessitent une intervention en premier, plutôt que d'essayer de tout corriger en même temps.

Ceux qui en bénéficient le plus :

Responsables produits, data scientists, équipes de conformité et de gestion des risques, et toute personne chargée de veiller à ce que les systèmes IA ne causent pas de préjudices disproportionnés. Essentiel pour les équipes opérant dans des domaines réglementés ou à enjeux élevés.

Comment l'utiliser :

Prévoyez 60 minutes. Travaillez à travers chaque groupe de parties prenantes du tableau 2, évaluez leurs scores de probabilité et de gravité, et placez-les sur la carte de chaleur.

Ce tableau est spécifique au projet, vous le répéterez donc pour chaque nouvelle initiative IA, mais le cadre reste le même.

Fait partie de la série d'ateliers sur l'atténuation des biais IA (Tableaux 3 à 4).